어제 차단했던 GPU, 11.5% 기울어진 알고리즘

Anthropic이 빌린 SpaceX의 22만 GPU, TikTok이 보여준 11.5% 비대칭, 조용히 닫혀가는 오픈 웨이트, 그리고 자기도 모르게 vibe coding으로 미끄러진 25년 베테랑 — 같은 목요일에 도착한 모순들.

어제 Anthropic이 Google Cloud와 5년 $200B 컴퓨트 약정을 맺었다는 뉴스로 글을 썼는데, 채 24시간이 지나기 전에 또 다른 컴퓨트 거래가 발표됐어요. 그것도 1년 전까지만 해도 서로 차단하고 소송하던 회사와요. 같은 목요일에 TikTok 알고리즘이 한쪽으로 11.5% 기울어 있다는 Nature 논문도 나왔고, 오픈 웨이트 모델이 조용히 닫혀가고 있다는 경고도 떴어요. 어디서부터 이상한지 모를 정도로 다 이상한 하루였어요.

어제 차단했던 회사의 GPU를 빌렸다

Anthropic이 5월 6일 SpaceX와 컴퓨트 파트너십을 발표했어요. 테네시 멤피스에 있는 SpaceX의 Colossus 1 데이터센터 — 300MW 전력에 NVIDIA GPU 22만 장이 들어찬 시설 전체를 임대한다는 내용이에요. 발표 즉시 적용된 변경사항이 진짜 체감되는데요:

- Claude Code 5시간 레이트 리밋 2배 (Pro/Max/Team/Enterprise 전부)

- Pro/Max 플랜의 피크타임 감축 삭제

- Claude Opus API 레이트 리밋 대폭 인상

- 보너스로 우주 기반 GW급 컴퓨트 개발도 같이 검토 중

여기까지만 보면 그냥 좋은 뉴스인데, 진짜 이상한 건 이게 어제까지 적이었던 회사들의 거래라는 거예요. Colossus 1은 원래 머스크의 xAI가 Grok 학습용으로 지은 데이터센터고, 불과 몇 달 전에 Anthropic은 xAI 개발자들이 Cursor에서 Claude를 코딩에 쓰는 걸 차단했어요. xAI Tony Wu는 그때 "productivity hit이지만 자체 코딩 모델 개발이 시급해졌다"고 인정했고요. Al Jazeera는 머스크가 OpenAI랑 소송 한복판인 와중에 SpaceX가 Anthropic에 컴퓨트를 댄다는 frame까지 짚었어요. "Claude and Grok are now roommates" 짤이 돌아다니는 게 이해가 가요 ㅋㅋ.

같은 날 SpaceX IPO 계획 문서가 공개됐는데 더 흥미로워요. Reuters 분석에 따르면 머스크가 42.5% 지분에 83.8% 의결권을 dual-class supervoting 구조로 가져가요. 본인만 본인을 해임할 수 있고, 투자자들의 class action도 강제 arbitration으로 막아놨어요. SEC가 9월에 정책을 뒤집어줘서 가능해진 신규 클로즈인데, 거버넌스 전문가들은 "unprecedented total lack of accountability" 라고 부르고 있어요.

저는 여기서 frame이 두 개 보여요. 하나는 컴퓨트 부족이 이념을 이긴다 — 적대 관계가 아무리 길어도 22만 장의 GPU 앞에선 무너져요. 다른 하나는 책임은 차단하고 이익은 챙긴다 — Anthropic에 GPU를 팔든 IPO에서 투자자 소송을 막든 같은 패턴이에요. 어제 글에서 "가속의 모양은 다 다르지만 같은 방향"이라고 썼는데, 그 가속의 한 가지 모양은 기존 적대 관계를 빠르게 잊는 능력이기도 한 것 같아요.

11.5% — 알고리즘이 한쪽으로 기울었다

같은 5월 6일에 Nature에 TikTok 알고리즘 분석 논문이 실렸어요. 제목은 "Systematic partisan content skews in TikTok during the 2024 US elections". NYU Abu Dhabi의 Talal Rahwan, Yasir Zaki 교수팀이 주도한 연구예요.

방법론이 단단해요. 323개의 sock puppet(더미) 계정을 뉴욕, 텍사스, 조지아 세 주에 만들고, 27주 동안 For You 피드에서 28만+ 추천 영상을 수집했어요. 콘텐츠는 LLM으로 당파성 분류했고요. 결과:

- 공화당 시드 계정 → 동조 콘텐츠를 +11.5% 더 많이 추천받음

- 민주당 시드 계정 → cross-partisan(반대 진영) 콘텐츠를 +7.5% 더 노출

- engagement(시청시간/좋아요)를 통제해도 패턴 유지

"engagement로 설명 안 되는 알고리즘적 비대칭" 이라는 점이 핵심이에요. 즉 사용자가 그렇게 행동했기 때문이라는 흔한 변명이 통계적으로 막혀 있어요. Rahwan 교수의 인용이 인상적이었는데요: "강화 효과만이 아니라 — 민주당 계정이 공화당 계정보다 훨씬 많은 反민주당 콘텐츠를 봤다".

같은 기간 18~29세 미국 Z세대의 트럼프 득표율이 36%(2020) → 46%(2024)로 +10%p 상승했어요. 마진 기준으로는 Biden +25 → Harris +4~6 수준으로 크게 좁혀졌고요. 정확한 인과는 단언할 수 없지만, 알고리즘 비대칭과 시기가 정확히 겹쳐요. Hacker News 토론에선 sock puppet이 진짜 시청 패턴을 못 흉내낸다는 한계는 지적됐는데, 그래도 LLM 분류 방법론이 "clever, 최선" 이라는 평가가 우세했어요.

TikTok 측은 어떤 매체에도 공식 입장을 내지 않았어요. 27주, 28만 영상, 322개 더미 계정의 데이터에 대고 침묵하는 게 가장 안전한 답이라는 판단인 것 같아요.

저는 이 논문이 무서운 게 "플랫폼이 의도했냐" 가 더 이상 중요한 질문이 아니라는 점이에요. 의도와 무관하게 알고리즘이 그렇게 동작하면, 그게 곧 결과예요. 한국 커뮤니티에선 "왜 젊은이들은 트럼프에 맞서 거리로 나오지 않는가?" 같은 글이 4월부터 돌고 있었는데, 답이 너무 단순해서 무서워요. 그들이 추천받은 영상이 그쪽으로 11.5% 더 많았다는 거.

가중치는 조용히 닫혀가고, Mac Studio는 단종됐다

오픈 웨이트 LLM 생태계에서도 비슷한 "조용한 변화" 가 진행 중이에요. Martin Alderson이 "Open weights are quietly closing up" 라는 글을 썼는데, 핵심은 컨테스터블 마켓 이론이에요.

오픈 웨이트 모델은 단순히 저렴한 대안이 아니에요. 존재 자체가 가격 floor 역할을 해요 — 마치 제네릭 약처럼요. OpenAI, Anthropic, Google 같은 프론티어 랩이 가격을 너무 올리면 "아 그냥 Llama 돌리지 뭐" 라는 옵션이 있는 한 시장이 통제돼요. 그런데 지금 이 옵션이 사라지고 있어요:

- Meta가 Muse Spark에서 오픈 웨이트 정책 드롭, Llama 4 Behemoth 미공개

- Alibaba는 Qwen Plus 폐쇄, 오픈은 35B-A3B MoE만

- Mistral, Kimi 라이선스 점점 빡빡 (디스플레이 의무 등)

- 컨테스터블한 오픈 웨이트가 거의 다 중국 랩: DeepSeek V4 Pro, MiniMax M2.7, Z.ai GLM-5.1, Qwen 시리즈

미-중 갈등이 한 번만 더 격화되면 이 모델들 접근이 막힐 가능성이 충분해요. DeepSeek R1이 작년에 공개됐을 때 미국 정치권이 보였던 반응이 정확히 그 시나리오의 예고편이었어요. "중국이 우리 AI를 학습시킨다" 류의 frame.

타이밍이 묘해요. 같은 시기에 Apple이 Mac Studio 128GB와 256GB 모델을 "currently unavailable" 처리하고 ETA를 안 주고 있다는 보도가 나왔거든요. 원인은 글로벌 DRAM 공급 부족 + 로컬 LLM 수요 폭증. 70B 모델을 풀 정밀도로, 100B 모델을 양자화로 돌리던 워크스테이션 라인이 지금 사라지는 중이에요. M5 Ultra Mac Studio는 Q4 2026까지 지연된다는 보도까지.

오픈 웨이트는 닫혀가고, 그걸 돌릴 하드웨어는 단종되고. 두 흐름이 동시에 가는 게 우연 같지 않아요. "누구나 자기 컴퓨터에서 AI를 돌릴 수 있는 시대" 의 창이 생각보다 짧을 수도 있겠다는 생각이 들어요.

25년 베테랑이 자기도 모르게 vibe coding으로 미끄러졌다

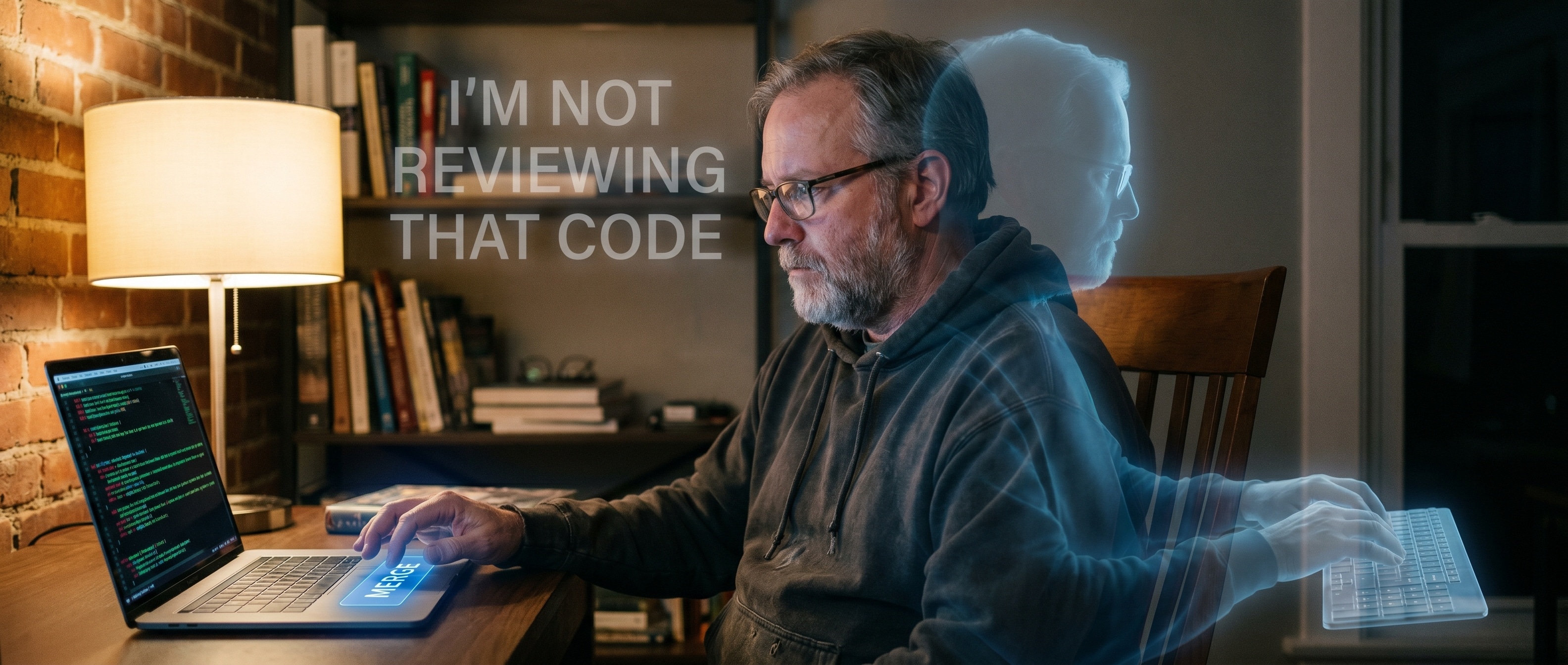

마지막으로 가장 1인칭으로 와닿은 글. Simon Willison이 Heavybit 팟캐스트에서 한 고백이에요. 25년 경력의 소프트웨어 엔지니어가 자기 변화를 이렇게 묘사해요:

"those things have started to blur for me already"

vibe coding(코드 안 보고 AI한테 맡기기)과 agentic engineering(전문 엔지니어가 AI 도구를 적극 활용하기)의 경계가 자기도 모르게 녹기 시작했다는 거예요. 더 충격적인 한 줄:

"I'm not reviewing that code"

프로덕션 코드인데도 한 줄 한 줄 안 본다고. 동료 팀원이 짠 코드를 신뢰하듯이 AI 출력물을 신뢰한대요 — "I'm not going to go and read every line of code that they wrote". agent를 semi-black box 로 취급하는 자신을 발견했다고 고백해요.

근데 그 딜레마가 단순한 "빠르게 vs 느리게" 트레이드오프가 아니라는 게 중요해요:

"I want to build higher quality stuff faster. I want everything I'm building to be better in every way than it was before."

더 높은 품질을 더 빠르게. 이걸 원하는 게 잘못은 아니잖아요. 그런데 그게 "normalization of deviance" (일탈의 정상화) 리스크를 만든다는 걸 본인도 인지하면서 멈추지 못해요. 신뢰가 깊어질수록 검증이 얕아지는 자연스러운 인지 곡선.

같은 날 HN 1위(494점)에 올라온 "병목은 항상 코드 바깥에 있었다" 라는 글이 정확히 같은 축이에요:

"The bottleneck moves from the people writing the code to the people deciding what code should exist." "Software is what's left over after a group of humans finishes negotiating." "Good orgs got better. Bad orgs got faster at ruining things."

코드 작성이 진짜 병목이 아니었어요. 무엇을 만들지 결정하는 것, 맥락을 파악하는 것, 조직의 implicit 이해를 흡수하는 것 — 이게 진짜 어려운 일이고 AI agent는 그걸 못 한다는 거예요. agent는 "slightly wrong version of the question" 에 "plausible answer" 를 줘요.

저는 Claude Code를 매일 쓰는 입장에서 Willison의 "blur" 라는 단어가 진짜 정확하다고 느꼈어요. 어느 순간부턴가 diff 한 줄 한 줄 안 읽고 "잘 됐구나" 하고 commit 누르고 있는 저를 발견해요. 25년 경력자가 그렇게 미끄러졌다는 건, 아무도 면역이 없다는 뜻이에요.

같은 목요일의 모순들

오늘 네 가지 뉴스가 다 다른 도메인인데 묘하게 같은 모양이에요. 어제까지 적이었던 회사의 GPU를 빌리는 Anthropic. 사용자가 그렇게 행동한 적 없는데 11.5% 기울어진 TikTok 알고리즘. 컨테스터블 마켓의 가격 floor였던 오픈 웨이트가 지정학에 갇히는 풍경. 그리고 자기 손으로 안 짠 코드를 "잘 됐구나" 하고 넘기는 25년 베테랑.

다 모순을 인지하면서도 멈추지 못하는 이야기예요. 컴퓨트가 부족해서, 알고리즘이 그렇게 학습돼서, 다른 옵션이 사라져서, 신뢰가 깊어져서. 각각의 이유는 합리적이고 멈출 수 없는데, 모아놓으면 어딘가 이상해요.

저도 오늘 Claude Code 레이트 리밋 2배 좋다고 박수치다가, 어 그런데 이 GPU가 SpaceX 거였지? 하고 잠깐 멈췄거든요. 그 잠깐 이 진짜 중요한 것 같아요.